Jak AI zmienia krajobraz pracy w IT – trzęsienie ziemi czy naturalna ewolucja?

Od hype’u do codzienności: AI jako nowy „stack”

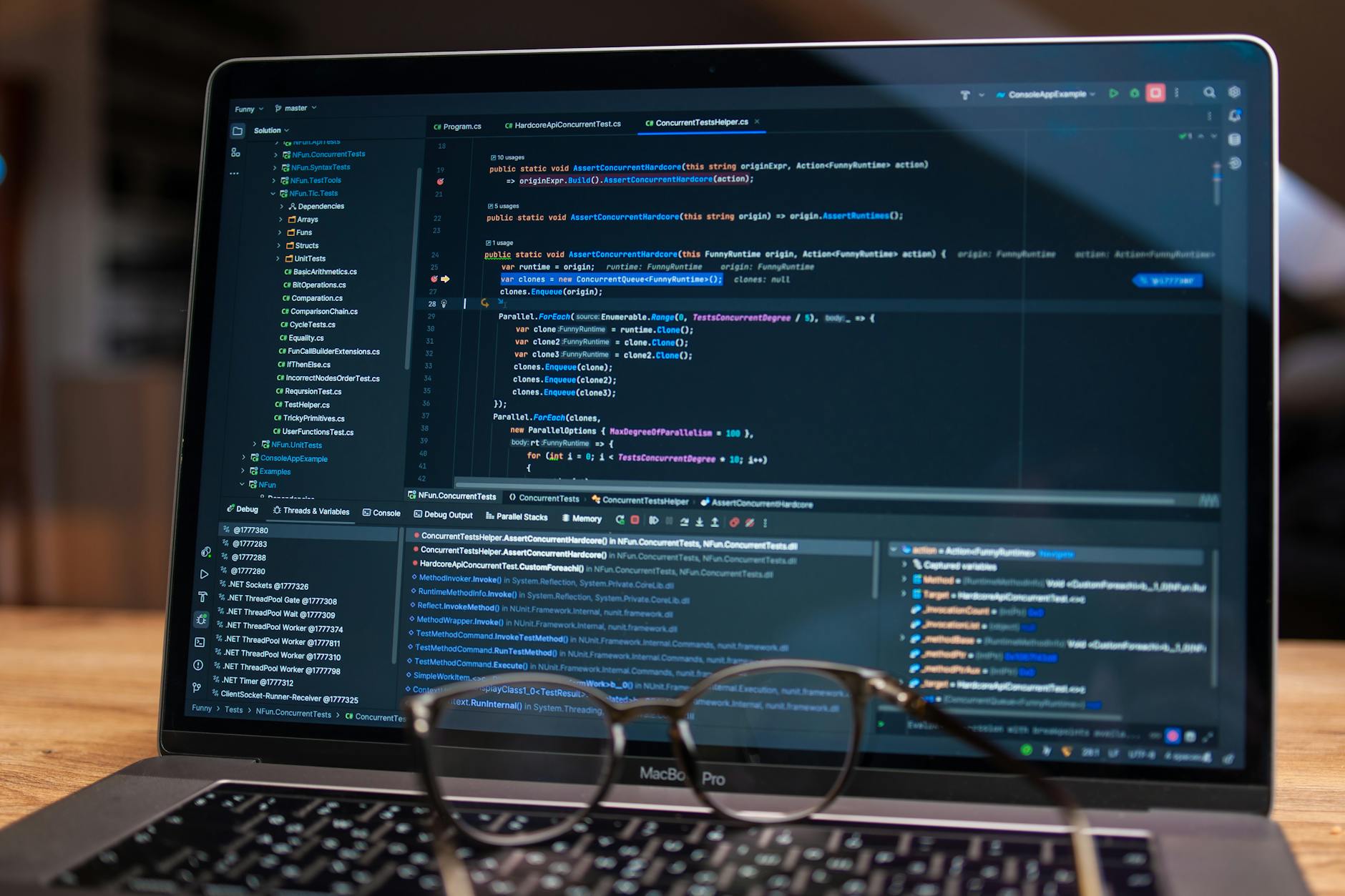

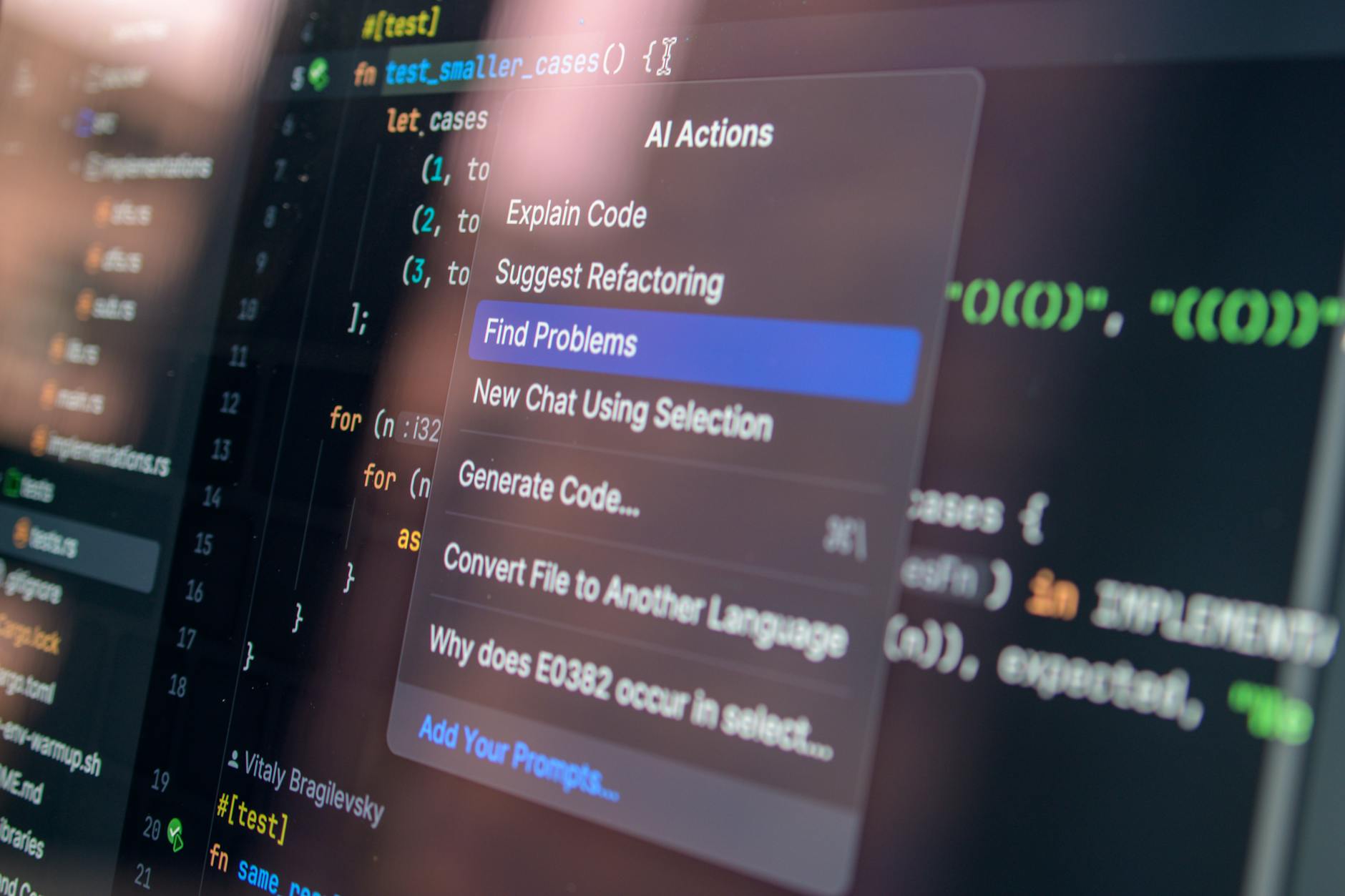

Sztuczna inteligencja w IT przestała być ciekawostką z konferencji, a stała się częścią codziennego „stacku” – tak samo realną jak Git, Docker czy framework front‑endowy. IDE podpowiadają całe funkcje, narzędzia typu copilot generują testy i dokumentację, a platformy no/low-code z wbudowanymi modelami językowymi pozwalają biznesowi tworzyć proste aplikacje bez udziału programisty. To już nie „kiedyś tam”, tylko teraźniejszość.

Dla wielu osób AI wciąż wygląda jak magiczna czarna skrzynka: wpisujesz prompt, wychodzi kod. Taki sposób myślenia jest wygodny, ale niebezpieczny. Znacznie rozsądniej traktować AI jak kolejne narzędzie w toolboxie – potężne, ale z konkretnymi ograniczeniami. Dobry inżynier wie, kiedy użyć młotka, a kiedy śrubokręta; podobnie z AI: są zadania, w których model błyszczy, oraz takie, w których generuje przekonujące bzdury.

Historia branży IT pokazuje, że lęk przed automatyzacją pojawia się regularnie. Kiedyś programiści obawiali się, że frameworki webowe „zabiją” zapotrzebowanie na ich pracę. Później, że biblioteki ORM sprawią, iż nikt nie będzie potrzebował zrozumienia SQL. W obu przypadkach rynek się zmienił, ale specjaliści, którzy rozumieli fundamenty i nauczyli się korzystać z nowych warstw abstrakcji, zyskali. Dziś to samo dzieje się z modelami językowymi.

Różnica polega na skali. AI dotyka równocześnie wielu obszarów: od kodu, przez dokumentację, po obsługę klienta i analizę danych. Dlatego powstaje wrażenie „trzęsienia ziemi”. W praktyce bliżej temu do gwałtownej, ale jednak ewolucji – z jasnymi wzorcami dla tych, którzy chcą świadomie zaplanować swoją ścieżkę kariery w IT.

Które zadania są najbardziej narażone na automatyzację

Modele generatywne świetnie radzą sobie z zadaniami, które są powtarzalne, bazują na istniejących wzorcach i nie wymagają głębokiego rozumienia kontekstu biznesowego. To właśnie takie fragmenty pracy w IT jako pierwsze przejmie automatyzacja. Z punktu widzenia programisty będą to przede wszystkim:

- generowanie tzw. glue code – prostego kodu łączącego komponenty i biblioteki,

- pisanie podstawowych testów jednostkowych i prostych scenariuszy e2e,

- tworzenie typowych integracji z popularnymi API, zgodnie z dokumentacją,

- produkowanie boilerplate’u: konfiguracji, szablonów, powtarzalnych kontrolerów.

Do tego dochodzi dokumentacja – od tworzenia wstępnych opisów endpointów, przez generowanie komentarzy w kodzie, po szkice README. AI radzi sobie także z rutynowymi migracjami i refaktoryzacją, szczególnie tam, gdzie reguły są jasne: „zmień nazwę pola w wielu plikach” czy „wyodrębnij powtarzający się fragment do osobnej funkcji”.

W tym miejscu pojawia się istotne rozróżnienie: zadanie vs rola. To, że AI przejmie 30–40% zadań na danym stanowisku, nie oznacza, że rola znika. Oznacza raczej, że profil pracy się przesuwa. Junior, który do tej pory pisał głównie glue code, będzie musiał szybciej zacząć rozumieć architekturę, domenę biznesową i umieć krytycznie oceniać kod generowany przez model. Senior, który poświęcał dużo czasu na powtarzalne code review, zacznie bardziej skupiać się na decyzjach projektowych i mentoringu.

Ta zmiana bywa bolesna dla osób, które zatrzymały się w strefie komfortu prostych zadań. Dla tych, którzy lubią rozwiązywać nieszablonowe problemy, to raczej dobra wiadomość: mniej „klepania”, więcej pracy koncepcyjnej.

Nowy podział pracy: człowiek jako projektant, AI jako wykonawca

Najprościej patrzeć na nową rzeczywistość przez analogię: człowiek jako architekt, AI jako ekipa budowlana. Architekt musi rozumieć wymagania klienta, lokalne przepisy, ograniczenia techniczne, budżet i ryzyka. Rysuje projekt, dobiera materiały i technologie, przewiduje problemy. Ekipa budowlana realizuje konkretne zadania na podstawie projektu, zgodnie z instrukcjami.

W IT rola ludzi przesuwa się właśnie w stronę tej architektonicznej perspektywy. Specjaliści muszą:

- rozumieć potrzeby biznesu i użytkowników,

- projektować sensowne rozwiązania (architekturę, przepływy danych, UX),

- dobierać miejsca, w których AI faktycznie wnosi wartość, a nie generuje chaos,

- ponosić odpowiedzialność za decyzje – także za te błędne.

AI natomiast staje się wykonawcą: generuje kod, tworzy warianty rozwiązań, przygotowuje wstępne analizy, pisze szablony testów czy raportów. Człowiek „dyryguje” tym procesem, zadaje odpowiednie pytania, weryfikuje efekty i integruje je w spójny system. Kluczowa różnica: odpowiedzialność nadal pozostaje po stronie człowieka.

Konsekwencje są dość oczywiste: w pracy dewelopera będzie mniej manualnego tworzenia powtarzalnych fragmentów, a więcej myślenia koncepcyjnego, pracy nad architekturą, komunikacji z innymi działami i tłumaczenia z „biznesowego” na „techniczny”. Z tego powodu na znaczeniu zyskują umiejętności, które do niedawna były traktowane jako „miłe dodatki”: zdolność do jasnego wyjaśniania złożonych kwestii, moderowania dyskusji, a nawet prowadzenia krótkich warsztatów z użytkownikami.

Najbardziej narażone i najbardziej odporne role w IT

Role o wysokim poziomie rutyny i powtarzalności

Role silnie oparte na powtarzalnych czynnościach są pierwszym kandydatem do „rozmontowania” przez automatyzację. Manual QA, który głównie klika te same scenariusze w interfejsie, prosty front‑end developer składający layouty z gotowych komponentów, czy podstawowy DevOps ustawiający powtarzalne pipeline’y – wszystkie te stanowiska mogą zostać częściowo „przepisane” na skrypty i modele.

Podobnie wygląda sytuacja administratorów systemów, którzy wykonują głównie rutynowe operacje: zakładanie kont, resetowanie haseł, wykonywanie standardowych backupów, monitoring według schematu. Duża część tej pracy może zostać ujęta w playbooki i zautomatyzowana z pomocą narzędzi IaC i asystentów AI, którzy generują skrypty, proponują konfiguracje, a nawet samodzielnie reagują na typowe alerty.

W obszarze testowania coraz więcej firm korzysta z AI do generowania test case’ów na podstawie user stories czy istniejącej dokumentacji. Model potrafi zaproponować listę scenariuszy, wygenerować dane testowe, a nawet szkice raportów błędów. Manual tester zyskuje więc narzędzie przyspieszające jego pracę, ale jeśli jego rola sprowadza się wyłącznie do wykonywania tych kroków mechanicznie, łatwo go zastąpić.

To nie oznacza, że te zawody znikną całkowicie. Zmienią się ich oczekiwania: manual QA, który potrafi projektować strategię testów, rozumie ryzyka biznesowe i potrafi pracować z automatyzacją oraz AI, staje się bardzo potrzebny. Problem mają osoby, które przez lata tkwiły w strefie „klikam to, co mi każą” i nie rozwijały się dalej.

Role wymagające głębokiego rozumienia systemów i biznesu

Na przeciwnym biegunie znajdują się role odporne na prostą automatyzację. To stanowiska, w których liczy się głębokie zrozumienie systemów, procesów i biznesu, a decyzje mają istotne konsekwencje. Architekt systemów musi balansować między wymaganiami niefunkcjonalnymi, budżetem, ograniczeniami organizacyjnymi i technicznymi. AI może podpowiedzieć wzorce, ale nie zna kontekstu polityki firmy, wewnętrznych zależności czy specyficznych kompromisów.

Product/technical lead łączy świat technologii z potrzebami użytkowników. Prowadzi rozmowy z biznesem, tworzy roadmapy, podejmuje decyzje o priorytetach, mediując między działami. Tu nie ma sztywnych schematów działania – każdy produkt żyje w innym środowisku, a konflikty interesów są normą. AI jest użyteczne jako narzędzie analityczne, ale nie zastąpi zaufania, relacji i odpowiedzialności.

W branżach o wysokich stawkach, takich jak finanse, medycyna czy systemy krytyczne, szczególnie dużo waży rola inżyniera bezpieczeństwa, SRE czy doświadczonego data/ML engineera. Błędy w tych obszarach mają konsekwencje wykraczające poza „nie działa przycisk”: w grę wchodzą kwestie regulacyjne, zdrowie ludzi, stabilność systemów o znaczeniu publicznym. Automatyzacja może pomóc wykrywać anomalie, ale ktoś musi zrozumieć, co one znaczą i jak bezpiecznie na nie reagować.

Data engineer i ML engineer, którzy nie tylko „kręcą modelami”, ale dbają o jakość danych, spójność pipeline’ów, zgodność z regulacjami i odpowiedzialne wykorzystanie informacji, stają się kluczowi. AI wspiera ich przy części zadań (np. generowanie kodu ETL, proponowanie transformacji), natomiast cały nadzór nad procesem, standardami i jakością pozostaje ludzką domeną.

Nowe i przekształcające się role związane z AI

Obok transformacji istniejących ról powstaje zestaw nowych lub intensywnie zmieniających się stanowisk. AI engineer / AI application developer to rola na styku klasycznego developmentu i uczenia maszynowego. Taka osoba niekoniecznie buduje modele od zera, ale potrafi je wybierać, fine‑tune’ować, łączyć z istniejącymi systemami poprzez API, projektować architekturę pod kątem użycia modeli oraz zadbać o monitoring jakości odpowiedzi.

Prompt engineer / AI interaction designer skupia się na projektowaniu interakcji człowiek–model. Wbrew powierzchownemu wrażeniu to nie tylko „wymyślanie promptów”. Chodzi o zrozumienie kontekstu, celów użytkownika, ograniczeń modelu, a potem zaprojektowanie odpowiednich formatów wejścia/wyjścia, workflowów i zabezpieczeń. W wielu firmach takie kompetencje wchłaniają istniejące role – np. analityk danych lub UX designer – zamiast tworzyć osobne stanowisko.

AI product owner / AI consultant łączy wiedzę domenową (np. prawo, medycyna, logistyka) z rozumieniem możliwości oraz ograniczeń AI. Taka osoba odpowiada za zdefiniowanie, gdzie w procesach danej firmy AI daje realną wartość, a gdzie jest tylko gadżetem marketingowym. W praktyce coraz częściej product owner w projektach IT „nasyca się” kompetencjami AI, zamiast oddzielać to w jedną, wąską rolę.

Podobny efekt widać u klasycznych frontendowców czy analityków danych: ich praca nie znika, natomiast narzędzia, z których korzystają, stają się coraz bardziej „inteligentne”. Frontendowiec musi rozumieć, jak embedować funkcje AI w interfejsie (np. asystenci piszący teksty, podpowiedzi w formularzach), a analityk danych – jak interpretować wyniki modeli, jak oceniać ryzyko biasu, jak wyjaśniać ograniczenia AI interesariuszom nietechnicznym.

Kluczowe kompetencje techniczne – co naprawdę zyska na znaczeniu

Solidne fundamenty – algorytmy, struktury danych, architektura

Modele generatywne potrafią napisać sortowanie, wyszukiwanie czy obsługę kolejki. Problem zaczyna się wtedy, gdy trzeba zdecydować, jakie sortowanie i jaką strukturę danych zastosować przy konkretnych ograniczeniach. AI nie zna twojego ruchu użytkowników, profilu danych, limitów pamięci czy wymagań SLA – chyba że je bardzo precyzyjnie opiszesz, a i wtedy wynik wymaga krytycznej oceny.

Umiejętność oceny złożoności czasowej i pamięciowej, projektowania struktur danych pod konkretne problemy oraz zrozumienie klasycznych wzorców architektonicznych (np. CQRS, event sourcing, mikrousługi vs monolit) staje się wręcz ważniejsza niż kiedyś. Dlaczego? Bo AI świetnie generuje kod, który „działa” na małych przykładach, ale może kompletnie się rozjechać skalą lub wydajnością w realnej produkcji.

Kto ma solidne fundamenty, ten potrafi rozpoznać, że wygenerowane rozwiązanie jest zbyt skomplikowane, nadmiernie sprzężone lub niewydajne. Taka osoba traktuje AI jak szybkiego, ale czasem nieuważnego juniora – przydaje się, ale nie można mu zostawić systemu bez nadzoru. Osoba bez fundamentów staje się natomiast zakładnikiem narzędzia: nie wie, czy wynik jest dobry, więc po prostu ufa lub odrzuca wszystko bez kryteriów.

Takie przesunięcie widać już w wielu firmach, w których zespoły IT, oprócz klasycznych zadań, prowadzą wewnętrzne szkolenia z AI dla innych działów. Część organizacji korzysta np. z materiałów takich jak praktyczne wskazówki: informatyka, a potem rozwija je własnymi scenariuszami, dopasowanymi do specyfiki branży. Deweloper zaczyna pełnić rolę przewodnika po świecie nowych technologii dla całej firmy.

Na znaczeniu zyskuje też umiejętność myślenia na poziomie architektury. Projektowanie komponentów, kontraktów między usługami, podziału odpowiedzialności, przepływu danych – to obszary, w których AI może podpowiedzieć warianty, jednak nie „czuje” realiów organizacyjnych, istniejącego długu technologicznego czy poziomu zespołu. To musi ocenić człowiek.

Rozumienie podstaw działania modeli AI (bez doktoratu z ML)

Nie każdy specjalista IT musi zostać deep learningowcem. Ale każdy, kto chce budować swoją karierę w świecie, w którym AI jest wszechobecne, powinien rozumieć kilka kluczowych pojęć. Różnica między klasycznym uczeniem maszynowym (regresje, drzewa decyzyjne, gradient boosting) a generatywnymi modelami językowymi czy obrazowymi to dobry punkt wyjścia.

Warto znać takie terminy jak:

Core pojęcia z zakresu AI w praktyce inżynierskiej

Kiedy programista lub inżynier danych zaczyna korzystać z modeli AI na co dzień, kilka pojęć nagle przestaje być akademicką ciekawostką, a staje się narzędziem pracy. Overfitting to już nie hasło z kursu ML, tylko bardzo realny problem, gdy model świetnie działa na danych historycznych, a kompletnie gubi się w nowych przypadkach. Bias przestaje być wyłącznie tematem etycznym, a zaczyna mieć konsekwencje produktowe: użytkownicy dostają gorsze rekomendacje, są niesprawiedliwie oceniani lub dostają nieadekwatne odpowiedzi.

Przydają się też pojęcia typu precision i recall, rozumiane nie tylko matematycznie, ale biznesowo. W systemie wykrywania fraudów możesz zaakceptować niższą precision (kilka fałszywych alarmów), jeśli znacząco podnosisz recall (łapiesz prawie wszystkie oszustwa). W medycznym asystencie diagnostycznym układ kompromisów wygląda inaczej, bo każdy fałszywy alarm lub przeoczenie ma inną wagę. Bez tego aparatu pojęciowego trudno świadomie projektować i oceniać systemy oparte o AI.

Podobnie jest z promptowaniem i tzw. prompt engineeringiem. Na pierwszy rzut oka to „pisanie lepszych pytań”. W praktyce chodzi o świadome zarządzanie kontekstem: jak zorganizować dane wejściowe, jak rozbić zadanie na kroki, jak ograniczyć model instrukcjami („nie wymyślaj danych, których nie znasz”), jak stosować few-shot learning poprzez przykłady w promptach. Deweloper, który rozumie, co dzieje się „w środku”, szybciej wyczuje, dlaczego małe zmiany w promptach potrafią dramatycznie zmienić wynik.

Data literacy i praca z danymi jako kompetencja przekrojowa

AI to w dużej mierze „maszyna na dane”. Bez sensownych danych, procesów ich zbierania i czyszczenia nawet najlepszy model będzie produkował śmieci. Dlatego umiejętność czytania, oceniania i modelowania danych staje się kompetencją, która przebija się przez różne role – od backend developera, przez analityka, po product managera.

Chodzi zarówno o twarde skille, jak operowanie na danych w SQL lub Pythonie, jak i o miękki aspekt: umiejętność zadania właściwego pytania do danych. „Czy ten wzrost to sezonowość, czy efekt zmiany funkcji?”, „Czy te dane są kompletne, czy brakuje jakiegoś segmentu użytkowników?”, „Czy te metryki nie są zaburzone przez zmianę sposobu logowania?”. AI może pomóc te pytania szybciej przetestować, ale to człowiek musi je w ogóle postawić.

W praktyce oznacza to, że nawet klasyczny developer powinien czuć się pewnie w takich czynnościach, jak:

- wyciągnięcie danych z bazy i sprawdzenie ich rozkładu,

- zrozumienie podstawowych metryk (średnia vs mediana, odchylenie standardowe, percentyle),

- wykrywanie anomalii w logach i eventach użytkowników,

- ocena, czy zbierane dane rzeczywiście odpowiadają na pytania, które zadaje biznes.

W wielu zespołach widać to już dziś: osoby, które potrafią „rozmawiać z danymi”, stają się naturalnymi punktami odniesienia przy decyzjach produktowych. AI jest tu dodatkową warstwą – pomaga szybciej agregować, wizualizować i interpretować, natomiast kierunek myślenia nadal musi wyznaczać człowiek.

Budowanie, integracja i utrzymanie systemów z komponentami AI

Kto pracował przy choć jednym projekcie z modelem wpiętym w produkcyjny system, ten wie, że sam model to najwyżej 20–30% pracy. Integracja, monitoring, fallbacki i obsługa błędów nagle rosną do rozmiaru pełnoprawnego projektu inżynierskiego.

Wyobraź sobie aplikację obsługi klienta, w której chatbot AI ma odpowiadać na większość pytań. Brzmi prosto, dopóki nie pojawią się zagadnienia typu:

- Jak zapewnić, że model nie „wymyśla” polityk firmy, których nie ma?

- Co się dzieje, gdy API modelu ma opóźnienia lub chwilowy outage?

- Jak przełączyć rozmowę na człowieka, gdy wykryjemy temat wrażliwy lub dużą niepewność odpowiedzi?

- Jak logować interakcje, by były przydatne do audytu i trenowania, a jednocześnie zgodne z RODO?

Te pytania dotykają klasycznego rzemiosła inżynierskiego: projektowania architektury, budowania mechanizmów circuit breaker, kolejek, retry, systemów alertów. Pojawia się też nowy obszar – monitoring jakości modeli: śledzenie wskaźników typu drift danych, zmiana rozkładu zapytań, rosnąca liczba skarg użytkowników na „dziwne” odpowiedzi.

Coraz większe znaczenie mają też wzorce integracji typu RAG (Retrieval-Augmented Generation), gdzie model nie bazuje wyłącznie na tym, co ma zakodowane w parametrach, ale dodatkowo sięga po dokumenty firmowe czy bazy wiedzy. Tu z kolei dochodzą kompetencje w zakresie wyszukiwania semantycznego, wektorowych baz danych, budowy indeksów i mechanizmów kontroli dostępu.

Inżynieria niezawodności i bezpieczeństwa w świecie AI

Każda nowa warstwa w systemie to nowa powierzchnia ataku i nowy punkt awarii. Komponenty AI nie są wyjątkiem – wręcz przeciwnie, potrafią wpuścić do systemu zupełnie nowe klasy zagrożeń. Pojawiają się ataki typu prompt injection, gdzie złośliwa instrukcja zaszyta w danych (np. w pliku PDF, treści strony, wiadomości e-mail) wpływa na zachowanie modelu. Są też próby wydobycia danych treningowych, ataki wywołujące halucynacje czy manipulujące wynikiem modelu.

Dla inżynierów bezpieczeństwa i SRE oznacza to konieczność poszerzenia wachlarza narzędzi: obok klasycznych skanerów podatności i WAF-ów trzeba testować systemy AI pod kątem odporności na nietypowe wejścia, sprawdzać mechanizmy sanitizacji danych, wprowadzać ograniczenia kontekstowe i polityki uprawnień nawet na poziomie promptów. „Brak błędu HTTP 500” nie oznacza, że system działa bezpiecznie – może grzecznie odpowiadać treściami, których absolutnie nie powinien generować.

W praktyce zyskują na znaczeniu takie kompetencje, jak:

Jeśli chcesz pójść krok dalej, pomocny może być też wpis: Jak czytać skład kosmetyków krok po kroku: praktyczny poradnik dla profesjonalistów.

- modelowanie zagrożeń specyficznych dla systemów AI,

- projektowanie sandboxów i izolacji dla komponentów modelowych,

- budowa mechanizmów walidacji i filtrowania wejścia/wyjścia modelu,

- projektowanie procesów incident response uwzględniających błędy i nadużycia AI.

Do tego dochodzi perspektywa regulacyjna: akty typu EU AI Act, wytyczne sektorowe (np. w bankowości) czy standardy branżowe. Inżynier, który potrafi połączyć techniczne aspekty AI z wymaganiami compliance, staje się nie tylko wykonawcą, ale partnerem dla prawników i działu ryzyka.

Umiejętność „rozmowy” z AI – od pojedynczych promptów do projektowania workflowów

Dawniej ważne było, czy ktoś „zna jakiś framework”. Dziś coraz wyraźniej widać inne pytanie: czy potrafi zaprojektować proces, w którym AI realnie pomaga, a nie przeszkadza? Chodzi o umiejętność rozbicia zadania na kroki, zdecydowania, które kroki wykonuje model, a które człowiek, oraz jak wygląda przepływ informacji między nimi.

Przykład z życia: zespół odpowiedzialny za przygotowanie ofert przetargowych postanowił użyć LLM do generowania wstępnych odpowiedzi. W pierwszym podejściu po prostu wklejali zapytanie ofertowe i prosili model o „napisanie odpowiedzi”. Efekt: dużo ładnego, ale niespójnego tekstu, który ktoś musiał ręcznie poprawiać. Kiedy jednak rozbili proces na etapy – najpierw ekstrakcja wymagań, potem zestawienie ich z biblioteką gotowych modułów oferty, a na końcu wygenerowanie spójnego dokumentu – okazało się, że model realnie skrócił czas pracy.

Ta zmiana myślenia dotyczy wszystkich ról technicznych. Nie chodzi tylko o to, by „podać dobrego prompta”, lecz by:

- świadomie decydować, gdzie AI ma prawo się mylić (np. draft maila), a gdzie musi być tylko asystentem (np. migracja bazy danych),

- projektować przepływy z recenzją człowieka w kluczowych miejscach,

- tworzyć małe, powtarzalne „klocki” AI, które można łączyć w większe procesy.

To rodzaj nowej „inżynierii procesów”, tylko że zamiast ludzi i klasycznych skryptów pracujemy z modelami, które mają swoje kaprysy i niepewność wyniku. Osoby, które dobrze czują projektowanie workflowów, będą bardzo rozchwytywane w projektach automatyzacji.

Jakość, czytelność i utrzymanie kodu w epoce generatywnej

Gdy AI generuje sporą część kodu, zmienia się rozkład akcentów w pracy inżyniera. Pisanie od zera schodzi na drugi plan, za to rośnie znaczenie czytania, oceniania i refaktoryzowania kodu. To trochę jak w redakcji: edytor tekstu nie musi pisać każdego akapitu, ale musi umieć szybko rozpoznać, co jest niespójne, co się powtarza, co trzeba wyrzucić.

Jeśli AI generuje kod, który „jakoś działa”, ale jest przegadany, pełen duplikacji i magicznych liczb, a zespół nie ma nawyku codziennego sprzątania, po kilku miesiącach powstaje monstrum, którego nikt nie chce dotykać. Umiejętność stawiania granic („tego nie mergujemy, dopóki nie będzie testów i sensownej struktury”), definiowania standardów, prowadzenia code review nabiera jeszcze większego znaczenia.

Dobry inżynier będzie więc:

- wykorzystywał AI do szybkiego prototypowania, ale samodzielnie projektował strukturę modułów,

- regularnie refaktoryzował wygenerowany kod, upraszczając go i dopasowując do konwencji zespołu,

- pilnował testowalności – bo jeśli kodu nie da się sensownie pokryć testami, AI będzie miało utrudnione zadanie przy kolejnych zmianach,

- traktował dokumentację (komentarze, ADR-y, README) jako równorzędny produkt, który również można częściowo generować, ale trzeba utrzymywać w ryzach.

Co ciekawe, rośnie też wartość „czystych” języków i frameworków, które narzucają spójną strukturę. Im mniej dowolności w tym, jak „można zrobić wszystko na sto sposobów”, tym łatwiej później ludziom i modelom odnaleźć się w kodzie. To kolejny powód, dla którego fundamenty i rzemiosło programistyczne wcale nie tracą na znaczeniu – one definiują ramy, w których AI ma działać.

Uczenie się w rytmie zmian – meta‑kompetencja przyszłych lat

W dynamicznie zmieniającym się krajobrazie technologicznym pojawia się jeszcze jedna, nie do końca „techniczna”, ale kluczowa kompetencja: zdolność szybkiego uczenia się i oduczania. Narzędzia AI, biblioteki, API modeli – to wszystko zmienia się dziś szybciej niż wersje popularnych frameworków sprzed dekady. Trzymanie się jednego stacku przez lata staje się coraz bardziej ryzykowną strategią.

Osoby, które budują w sobie nawyk eksperymentowania – sprawdzają nowe narzędzia, wpinają je w małe fragmenty pracy, uczą się na prototypach – mają dużo większą szansę, że przepłyną przez kolejne fale zmian spokojnie. To trochę jak z nauką języka obcego: kto raz „przestawił się” na myślenie w innym języku, kolejne przychodzą mu łatwiej.

Przekłada się to na praktykę dnia codziennego:

- regularne testowanie nowych funkcji w IDE i narzędziach AI, zamiast zostawiania ich „na później”,

- śledzenie nie tylko technologii, ale i wzorów użycia – jak inne firmy projektują procesy z AI, jakich błędów się dopuściły,

- aktywny udział w kulturze dzielenia się wiedzą w zespole – krótkie demo, wewnętrzne wiki, przykłady promptów czy wzorców integracji.

Ta meta‑kompetencja nie jest zarezerwowana dla seniorów. Junior, który potrafi szybko oswoić się z nowym narzędziem AI i sensownie je wpiąć w swoją pracę, często nadrabia braki doświadczenia czystą sprawnością adaptacji. Z czasem, gdy dołoży do tego fundamenty teoretyczne i praktykę systemową, staje się bardzo mocnym graczem na rynku, który AI dopiero zaczyna kształtować.

Kompetencje „miękko‑twarde”: tam, gdzie technologia spotyka biznes

AI wchodzi do firm nie po to, by było „nowocześniej”, tylko po to, by szybciej dowozić wartość. Technologia przestaje być osobną wyspą – staje się tkanką, która przenika procesy sprzedaży, obsługi klienta, logistyki czy finansów. To powoduje, że rośnie zapotrzebowanie na ludzi, którzy z jednej strony rozumieją, jak działa model i architektura systemu, a z drugiej potrafią rozmawiać z biznesem jego językiem.

Często to właśnie inżynier, analityk czy architekt musi odpowiedzieć na bardzo konkretne pytania: gdzie AI realnie skróci proces, a gdzie tylko doda chaos? Kiedy opłaca się inwestować w własny model, a kiedy wystarczy gotowe API? Jak wytłumaczyć ryzyko halucynacji osobie, która nie ma technicznego backgroundu, ale odpowiada za budżet i reputację marki?

Bez takiego „mostu” między technologią a biznesem rośnie ryzyko powstawania projektów‑wydmuszek: ładne demo na konferencję, a potem brak adopcji, bo nikt nie zmapował potrzeby na konkretny proces, wskaźniki i odpowiedzialności.

Umiejętność przekładania AI na język decyzji biznesowych

Świadome użycie AI wymaga kilku sprawności, które trudno jednoznacznie zaklasyfikować jako „miękkie” lub „twarde”. To raczej zestaw umiejętności translatorskich. Techniczna osoba musi nie tylko wiedzieć, jak skonfigurować model, ale też potrafić opowiedzieć o tym w sposób zrozumiały dla osób nietechnicznych.

Przydaje się tu szczególnie:

- myślenie w kategoriach problemu, a nie technologii – zamiast „użyjmy LLM”, raczej: „mamy ręczne, powtarzalne kroki, które można rozbić na klasyfikację, ekstrakcję danych i generowanie podsumowań”; dopiero potem dobiera się narzędzia,

- umiejętność szacowania wpływu – ile czasu można potencjalnie zaoszczędzić, ile błędów zredukować, jak zmieni się cykl decyzyjny; nie zawsze w liczbach co do sekundy, czasem wystarczy rząd wielkości i scenariusz „minimalny‑optymistyczny”,

- jasne komunikowanie ryzyk – nie technicznym żargonem o „overfittingu”, lecz opisowo: „system może się mylić w takich‑a‑takich sytuacjach, dlatego tam zawsze jest krok z weryfikacją człowieka”.

Dobry specjalista IT staje się tu trochę jak doradca inwestycyjny: klient (biznes) przychodzi z problemem, a rolą doradcy jest dobrać portfel rozwiązań – z ograniczeniami, scenariuszami i planem wyjścia, jeśli coś nie zadziała.

Praca zespołowa w projektach AI – nowe role i nowe napięcia

Projekty z AI rzadko mieszczą się już w prostym układzie „product owner + dev + QA”. Dochodzą nowe role: specjaliści ds. danych, eksperci domenowi, osoby od ryzyka i compliance, czasem wewnętrzne zespoły „AI governance”. Zderzają się różne języki, priorytety i tempa pracy.

Typowy przykład: inżynierowie chcą szybko wdrożyć MVP z LLM, eksperci od bezpieczeństwa hamują – bo niejasny jest przepływ danych, a dział prawny dopytuje o jurysdykcję serwerów i retencję logów. Jeśli brakuje kogoś, kto spina te światy i potrafi prowadzić rozmowę z każdą ze stron, projekt potrafi utknąć na miesiące.

Zyskują więc osoby, które:

- potrafią facylitować rozmowy między techniką a biznesem – zadawać pytania, porządkować ustalenia, wciągać do stołu ludzi z różnych działów,

- są gotowe negocjować kompromisy – np. w pierwszej wersji ograniczamy zakres modelu, ale uruchamiamy dokładne logowanie i mechanizmy wycofania zmian,

- umieją rysować proste modele – diagram procesu, mapa przepływu danych, schemat interakcji człowiek–AI; często kartka i marker rozwiązują więcej niż dwudziestostronicowy dokument.

To nie jest „miękka otoczka” dla twardej technologii. Bez tych umiejętności nawet najlepszy model pozostanie w proof‑of‑conceptach.

Nowe ścieżki kariery w IT napędzane przez AI

Wejście AI na szeroką skalę nie oznacza tylko modyfikacji istniejących ról. Dla wielu osób to okazja do przeskoczenia na trochę inne tory – często bliżej biznesu, produktu czy danych, ale wciąż z oparciem w kompetencjach technicznych.

Architekt rozwiązań AI i „AI‑product engineer”

W klasycznych projektach mieliśmy architektów systemowych czy cloudowych. Dziś coraz częściej pojawia się osoba, która odpowiada przede wszystkim za architekturę użycia modeli w konkretnym kontekście biznesowym. Czasem tytuł brzmi „AI Architect”, czasem „AI Solution Engineer” czy „AI‑product engineer”, ale sedno jest podobne.

Taka rola wymaga kilku filarów:

- rozumienie modeli – nie na poziomie pisania własnych transformerów, lecz świadomości, co oznacza kontekst, tokeny, latencja, ograniczenia długości wejścia,

- projektowanie architektury integracji – gdzie stoi model, jak komunikują się z nim serwisy, jak rozwiązujemy autoryzację, logowanie, wersjonowanie promptów i konfiguracji,

- świadomość kosztów – modele to nie tylko „API za parę centów”, ale też koszty transferu, pamięci, eksperymentów i ewaluacji.

W praktyce taki architekt często spędza czas nie tylko przy diagramach, ale też przy prototypach – klei pierwsze wersje workflowów, testuje różne modele, mierzy, czy przy obecnym wolumenie zapytań budżet „się spina”.

Specjalista ds. jakości i ewaluacji systemów AI

Klasyczny QA sprawdzał głównie: czy funkcja zwraca poprawny wynik, czy UI nie sypie błędami, czy API zachowuje się zgodnie z kontraktem. W świecie AI pojawia się dodatkowy wymiar: jakość merytoryczna i spójność odpowiedzi.

To rodzi zapotrzebowanie na osoby, które:

- projektują zbiory testowe dla modeli – od prostych benchmarków po scenariusze specyficzne dla danej domeny (np. medycznej, prawnej, finansowej),

- znają metody oceny jakości tekstu, klasyfikacji, rekomendacji – nie tylko automatyczne metryki, ale też procesy oceny przez ludzi (tzw. human‑in‑the‑loop),

- budują dashboardy jakości – które nie zatrzymują się na „accuracy 92%”, ale pokazują, gdzie model zawodzi, jak zmienia się to w czasie, co się dzieje po zmianie promptu lub wersji modelu.

To świetna ścieżka dla osób z doświadczeniem w QA, które chcą wejść mocniej w obszar danych i statystyki, ale niekoniecznie pisać modele od zera.

„AI champion” w zespołach domenowych

Nie wszystkie nowe role będą miały w nazwie „AI”. W wielu firmach pojawia się po prostu osoba, która staje się lokalnym ekspertem od sensownego używania narzędzi AI w konkretnym zespole: w finansach, HR, marketingu czy obsłudze klienta.

Najczęściej to ktoś z doświadczeniem domenowym, kto dodatkowo:

- ma dryg techniczny – potrafi samodzielnie zbudować prosty workflow, podłączyć się do API czy zautomatyzować fragment pracy,

- jest w stanie przygotować „bibliotekę sprawdzonych zastosowań” – konkretne prompty, szablony, checklisty z ograniczeniami („tego nie wrzucamy do narzędzia chmurowego”),

- pełni rolę pierwszej linii wsparcia – pomaga kolegom dobrać narzędzie, doradza, jak ramach zasad bezpieczeństwa korzystać z AI na co dzień.

Dla wielu specjalistów IT to naturalny kierunek rozwoju: z roli stricte technicznej w stronę roli, która łączy kompetencje technologiczne z pracą warsztatową, szkoleniową i doradczą w organizacji.

Jak przygotować się praktycznie – strategie dla różnych etapów kariery

Rewolucja AI w IT nie wydarzy się w jeden dzień, ale nie rozciągnie się też w nieskończoność. Kto zacznie działać teraz, ma szansę potraktować ją jako przyspieszacz kariery, a nie zagrożenie. Kluczowe jest dopasowanie strategii do miejsca, w którym się jest.

Pierwsze lata w zawodzie – budowanie fundamentów i higieny pracy z AI

Dla osób na poziomie junior/regular najważniejsze staje się połączenie trzech elementów: solidnej bazy (algorytmy, architektura, bazy danych), nawyków pracy z AI i zdrowego sceptycyzmu wobec „gotowców”.

Kilka praktycznych kroków, które mocno procentują:

- prowadzenie własnego „notesu promptów” – krótkie przykłady, które się sprawdziły: generowanie testów, szablony refaktoryzacji, wzory pytań do debugowania; z czasem to staje się prywatną biblioteką trików,

- świadome używanie AI do nauki – proszenie modelu o alternatywne rozwiązanie zadania, o porównanie podejść, o wskazanie brakujących testów; nie chodzi o kopiowanie, tylko o konfrontowanie swojego myślenia,

- regularne „rozbieranie” wygenerowanego kodu – dlaczego AI napisało to tak, a nie inaczej, co można uprościć; to trochę jak uczenie się z cudzego kodu, ale przyspieszone.

Osoba, która od początku kariery traktuje AI jako partnera do myślenia, a nie „magiczny automat”, szybko zyskuje przewagę – po prostu szybciej przechodzi kolejne etapy rozwoju.

Mid i senior – przejście z roli wykonawcy do projektanta systemów z AI

Bardziej doświadczeni specjaliści są w najlepszej pozycji, by stać się projektantami i „reżyserami” systemów, w których AI jest jednym z aktorów. Tutaj kluczowe staje się kilka przesunięć akcentów.

Po pierwsze – więcej czasu na projektowanie i ewaluację, mniej na ręczne „klepanie” kodu. Senior, który nauczy się delegować powtarzalne fragmenty pracy AI, zyskuje przestrzeń na:

- modelowanie domeny i architektury,

- projektowanie kontraktów między modułami (w tym modułami AI),

- uczenie młodszych kolegów, jak mądrze korzystać z narzędzi.

Po drugie – wejście głębiej w dane. Nawet jeśli ktoś nie planuje zostać data scientist, umiejętność przeanalizowania jakości danych wejściowych, zrozumienia ich rozkładów, wykrycia oczywistych biasów staje się częścią codziennej pracy. To znacznie bardziej przypomina klasyczną inżynierię (logowanie, monitoring, alerty) niż „magiczne czary z modelami”.

Po trzecie – rozwój kompetencji mentoringowych. Projekty AI są często stresującą zmianą dla reszty zespołu. Senior, który potrafi spokojnie wyjaśnić, co się zmieni i jak z tego skorzystać, buduje nieformalny autorytet. To później przekłada się na rolę Tech Leada, Architekta czy Managera Inżynierii.

Zmiana specjalizacji – z klasycznego IT w stronę AI bez „resetu” kariery

Wielu specjalistów z wieloletnim doświadczeniem zastanawia się, czy muszą „rzucić wszystko i zostać data scientistami”, żeby nie zostać z tyłu. Najczęściej odpowiedź brzmi: nie trzeba resetować licznika, można raczej zbudować „nakładkę AI” na to, co już się umie.

Kierunki, które szczególnie dobrze się sprawdzają:

Jeśli interesują Cię konkrety i przykłady, rzuć okiem na: 5G vs WiFi 6: co wybrać do domu i biura?.

- „AI‑native” DevOps / platform engineer – budowa platform do trenowania, wdrażania i monitorowania modeli, rozszerzanie istniejących narzędzi CI/CD o testy i walidację komponentów AI,

- „AI‑savvy” analityk biznesowy / produktowiec – projektowanie funkcji produktowych wykorzystujących AI, definiowanie metryk sukcesu, praca na styku zespołów inżynierskich i biznesu,

- specjalista od bezpieczeństwa AI – rozszerzenie klasycznego security o aspekty prompt injection, eksfiltracji danych, nadużyć modeli i zgodności z regulacjami.

W każdym z tych scenariuszy dotychczasowe doświadczenie jest atutem, a nie balastem. Krytyczne staje się natomiast systematyczne dokładanie nowych klocków: znajomości narzędzi MLOps, rozumienia architektury modeli, umiejętności pracy z danymi tekstowymi czy logami z interakcji z modelem.

Organizacje uczące się AI – kompetencje zespołowe, nie tylko indywidualne

Rynek pracy w IT coraz mocniej nagradza nie tylko indywidualnych „magików od AI”, ale całe zespoły i firmy, które potrafią uczyć się jako organizacja. To przesuwa punkt ciężkości z jednostkowego „ja się nauczę nowego narzędzia” na wspólne praktyki, standardy i kulturę pracy.

Wspólne repozytoria wiedzy o AI i „wewnętrzne GitHub Copiloty”

Coraz częściej w zespołach pojawiają się wewnętrzne „kopalnie wiedzy” o użyciu AI: zbiory promptów, przykłady integracji, opisy udanych (i nieudanych) eksperymentów. Dobrze prowadzone, stają się czymś w rodzaju wewnętrznej dokumentacji praktyk, która przyspiesza wdrażanie nowych osób i powielanie udanych rozwiązań.

Kluczowe elementy takiej praktyki to:

Co warto zapamiętać

- AI staje się stałym elementem „stacku” w IT – tak jak Git czy Docker – i przestaje być gadżetem; kto nauczy się traktować ją jak zwykłe narzędzie z konkretnymi ograniczeniami, zyska przewagę.

- Najpierw automatyzowane są zadania powtarzalne i oparte na wzorcach: glue code, boilerplate, proste testy, rutynowa refaktoryzacja i dokumentacja – ale to są zadania, nie całe role.

- Zakres obowiązków na stanowiskach się przesuwa: juniorzy muszą szybciej wchodzić w zrozumienie architektury i domeny biznesowej, seniorzy mniej „klepią” i robią powtarzalne code review, a więcej projektują i mentorują.

- Pojawia się wyraźny podział: człowiek jako projektant i decydent (rozumie biznes, projektuje rozwiązania, wybiera, gdzie użyć AI), a AI jako wykonawca generujący kod, analizy i szkice – odpowiedzialność za efekt końcowy nadal pozostaje po stronie człowieka.

- W pracy specjalistów IT rośnie udział zadań koncepcyjnych i komunikacyjnych: dogadywanie się z biznesem, tłumaczenie z „biznesowego” na „techniczny”, prowadzenie warsztatów czy wspólne projektowanie rozwiązań z użytkownikami.

- Role mocno oparte na rutynie i odtwarzaniu schematów (np. ręczne testowanie powtarzalnych scenariuszy, proste składanie front‑endu, podstawowe pipeline’y DevOps) są najbardziej narażone na częściową automatyzację.

- Kluczową przewagą staje się umiejętność krytycznego korzystania z AI – nie ślepe przyjmowanie wygenerowanego kodu, lecz ocenianie, poprawianie i wpasowywanie go w szerszy kontekst systemu oraz potrzeb biznesu.

Źródła informacji

- The Future of Jobs Report 2023. World Economic Forum (2023) – Prognozy wpływu automatyzacji i AI na rynek pracy, w tym IT

- Generative AI and the Future of Work in America. McKinsey Global Institute (2023) – Analiza zadań najbardziej podatnych na automatyzację przez generatywną AI

- OECD Employment Outlook 2023: Artificial Intelligence and the Labour Market. OECD (2023) – Wpływ AI na zatrudnienie, zmiany ról i wymaganych kompetencji

- The Economic Impact of Artificial Intelligence on Jobs. International Labour Organization (2024) – Ocena ryzyka automatyzacji różnych zawodów i zadań

- AI and the Future of Programming. ACM Queue (2023) – Dyskusja o zmianie pracy programistów pod wpływem narzędzi AI

- The Impact of AI on Developer Productivity. Microsoft Research (2023) – Badania nad wpływem narzędzi typu Copilot na pracę deweloperów

- Copilot Productivity Study. GitHub (2022) – Eksperyment mierzący, jak asystenci AI zmieniają strukturę zadań programistów